Controlnet是近年来AI画图领域风头最劲的图像可控生成技术,极大扩展了用户对画面结构、风格的精准把控能力。它基于Stable Diffusion深度架构,通过边缘、骨骼、分割、法线等多种“条件图”,大幅提升AI出图准确率与交互体验。本文系统解析controlnet原理、主流模型、生态工具与实战教程,助设计师、业余创作者高效掌控AI绘画流程,打造更高质量和个性化作品。

controlnet 的基本原理与架构进阶

什么是 controlnet?AI 绘图控制的革命性方案

controlnet 是用于“可控图像生成”的AI模型,嵌入于Stable Diffusion体系,允许用户凭直观条件图(如边缘、骨架、分块等)直接干预AI出图结构和风格,极大增强AI画图的准确性与实用性。相比传统依赖文字prompt的AI绘画,controlnet凭多通道输入,实现了“照葫芦画瓢”乃至精细部位重新渲染。

controlnet 为什么能改变 AI 绘画体验?

- 可控性极强:手绘边线、骨架、分割图,精准把握AI画面构图与动作。

- 全场景适配:线稿、OpenPose、语义分割、深度图等多模态通用,跨媒体创作自如。

- AI编辑进化:实现局部修补、人物调整、换景植入、风格迁移,赋予AI手工级操作力。

controlnet 工作流程解构

| 步骤 | 说明 |

|---|---|

| 1. 预处理 | 自动生成“控制条件”如Canny边缘或OpenPose姿态 |

| 2. 编码 | controlnet将控制信息编码混入主模型 |

| 3. 去噪迭代 | 主模型与controlnet联合优化,精准还原结构 |

| 4. 多种融合 | 可多通道组合,复杂块体/风格/部位同步控制 |

| 5. 输出 | 输出结果自动符合条件图结构与要求 |

controlnet 主要模型种类与生态

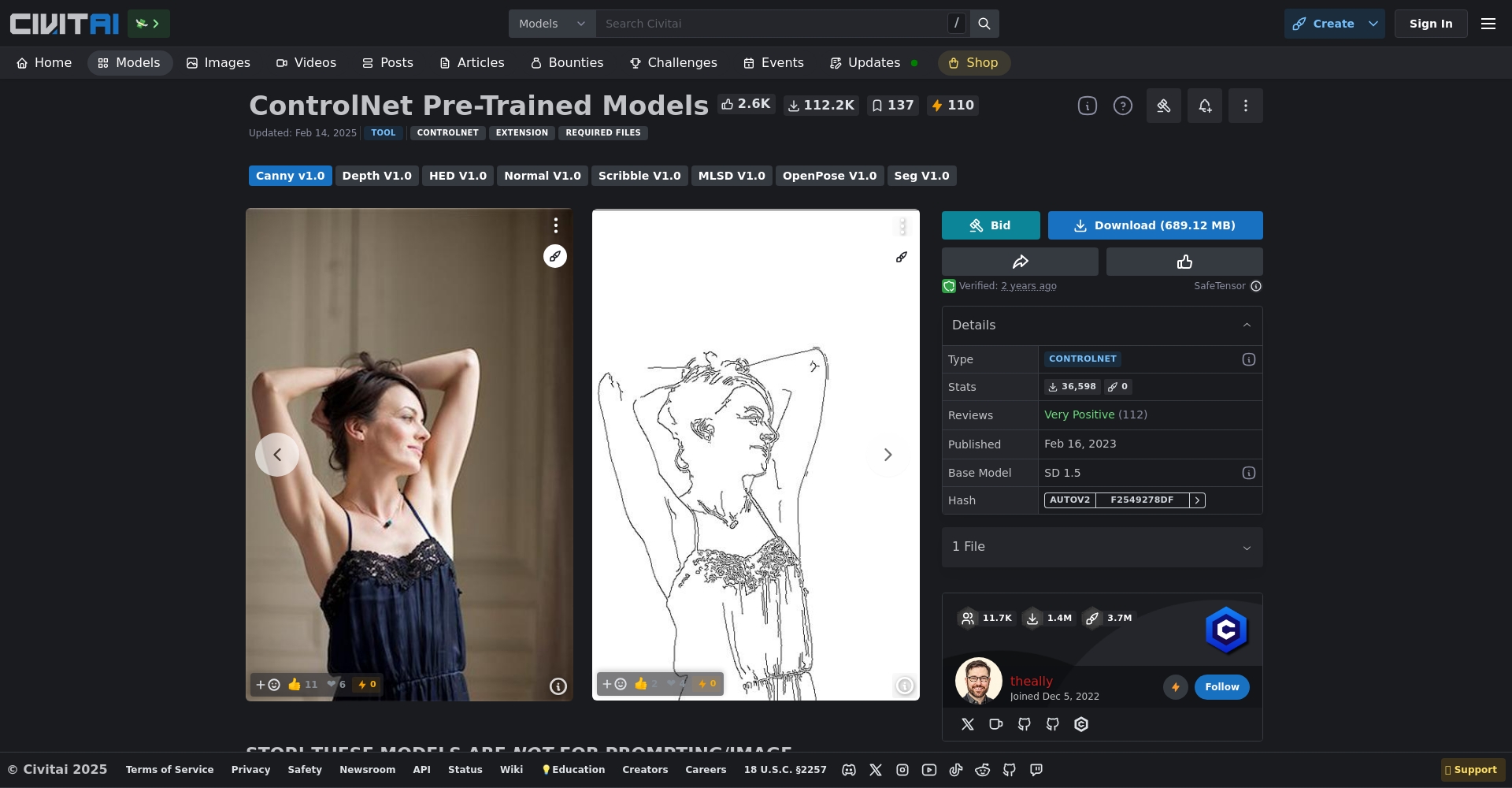

官方及社区主流控制模型清单

| 控制模型 | 简称/文件 | 典型场景 | 描述 |

|---|---|---|---|

| canny | control_v11p_sd15_canny | 产品/建筑线稿 | 边缘检测,高还原形态 |

| inpaint | control_v11p_sd15_inpaint | 局部修补重绘 | 区域修改,保主体不变 |

| lineart | control_v11p_sd15_lineart | 角色/工业绘稿 | 线稿细节稳定输出 |

| mlsd | control_v11p_sd15_mlsd | 室内外结构图 | 直线建模,工业与建筑绘画 |

| openpose | control_v11p_sd15_openpose | 动作分镜/动态 | 骨架还原人物动作 |

| scribble | control_v11p_sd15_scribble | 涂鸦转正式画 | 乱涂线稿高效生成成品 |

| normalbae | control_v11p_sd15_normalbae | 3D渲染 | 专业级法线、光照管理 |

| seg(segmentation) | control_v11p_sd15_seg | 分割换色/叠加 | 色块精准区域控制 |

| softedge | control_v11p_sd15_softedge | 风景/肖像 | 柔和边缘,细腻表现 |

| tile | control_v11f1e_sd15_tile | 大图修复 | 切块优化细节层次 |

| depth | control_v11f1p_sd15_depth | 空间/抠图 | 深度控制空间感/换景 |

| anime lineart | control_v11p_sd15s2_lineart_anime | 二次元上色 | 专为动漫优化,多风格适配 |

SDXL 及第三方控制net种类日益丰富,高端生态活跃,参考 Huggingface, CivitAI 等模型库。

controlnet 在主流生态中的高度集成

- 兼容Stable Diffusion WebUI、ComfyUI、秋叶整合包等,无需代码即可精细作画。

- 多数生态内置多控制模型插件,新手10分钟可上手,专业需求全场景覆盖。

- SD1.5/SD2.0官方维护,SDXL社区深度发展,组合玩法灵活多变。

controlnet 的实战技巧&高阶用法

1. 单个 controlnet 模型的实用场景

- 角色三视图: openpose骨架图配三视效果,自动生成风格统一的角色三视图。

- 精准光源/质感: depth与normalbae联动,指定光向与材质渲染。

- 区域换色/增物: segmentation模型分割,分区抓取或换色(如蓝区加船)。

- 乱画生成正式AI画: scribble模式下随意线稿迅速变精致成品。

2. 多 controlnet 组合的高阶技巧

| 用法类型 | 组合模型 | 操作要点 |

|---|---|---|

| 手脚精准 | openpose+depth+canny | openpose控结构,depth控空间 |

| 多角色分块 | segmentation+openpose | 分块定区,骨架控动作 |

| 主体背景分离 | openpose+depth或tile | 前景骨架配背景深度 |

| 风格迁移分块上色 | canny+T2I-Adapter | canny定细节,Adapter定风格 |

| 局部重绘复合 | seg+inpaint | 分割后局部重改快速切换 |

3. Controlnet 插件与工具大全

| 工具/插件 | 用途说明 | 获取方式 |

|---|---|---|

| Stable Diffusion WebUI | 主流可视化AI绘图平台,内置controlnet | 项目地址 |

| ComfyUI | 节点式AI绘图,参数自定义极强 | 项目主页 |

| 秋叶AI绘画套件 | 零门槛AI绘画傻瓜包 | 秋叶AI |

| Controlnet Extensions | 各类子插件如reference、edit、lora联动等 | 官方插件库 |

| Canny/Segment/Refer. | 图像预处理与多模态支持 | 主流WebUI内置 |

使用 controlnet 的常见问题与实用建议

Q1: controlnet 支持哪些Stable Diffusion版本?

- 主推SD1.5/SD2.0,社区已支持SDXL 1.0/1.5及后续SD3。

Q2: controlnet如何提升出图准确率?

- 需文本prompt、LoRA精调、controlnet条件图三步联动,多次微调权重,精准还原。

Q3: controlnet多通道激活时注意什么?

- 多模型协同易互相干扰,建议先单模型调优,组合仅做细微补差,配合局部重绘。

Q4: controlnet对硬件有要求吗?

- 至少推荐16GB显存(RTX3060及以上),部分云端平台或网页也可低门槛体验。

controlnet应用场景一览

| 行业/场景 | 主要应用 | controlnet支持模型 |

|---|---|---|

| 电商设计 | 产品换色、智能抠图、批量出图 | canny, seg, depth |

| 广告/平面 | 角色组合、novel pose | openpose, scribble |

| 动漫/游戏美术 | 三视图生成、大批量动作风格化 | openpose, anime lineart |

| 建筑/室内方案 | 结构图复刻、风格转换 | mlsd, tile, canny+T2I |

| 医学影像 | 分割高亮、区域辅助诊断 | seg, depth |

| 教育/科普 | 彩图示范、交互演示 | seg, normal, inpaint |

| 智能后期 | 一键换景、精修年代感 | depth, inpaint, reference |

2024年以来,controlnet及其生态正席卷AI绘画产业,从专业设计、插画到普通爱好者,controlnet让AI出图像玩素描板一样随心所欲。用好controlnet,你的创新效率和作品质量将迈上新台阶。展望未来,AI图像创作工具必将赋予人类更多创造力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...